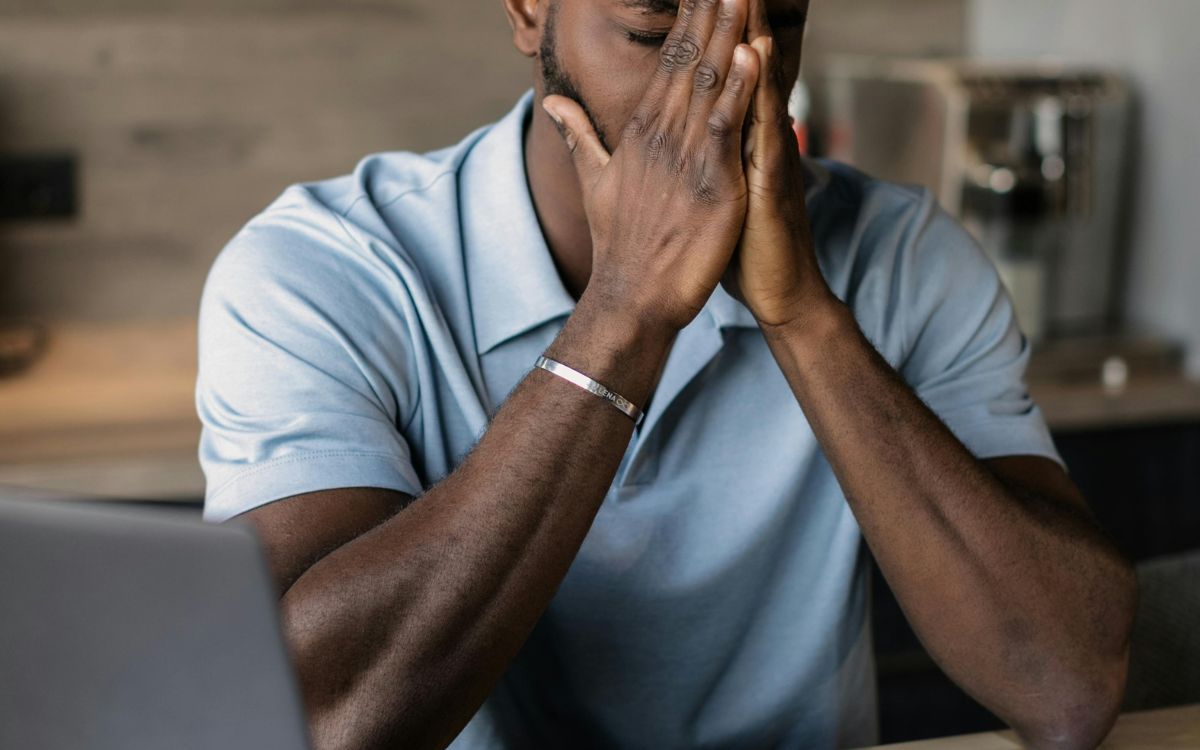

¿Por qué en Estados Unidos prohíben el uso de IA para atender salud mental?

Un hombre estaba enamorado de 'Juliette', su chatbot, y se convenció de que ella había sido asesinada por OpenAI. Antes de lanzarse contra los agentes con un cuchillo, escribió al chatbot: 'Hoy me muero'.

- Redacción AN / JFA

En los últimos meses, varias entidades de Estados Unidos prohibieron o restringieron el uso de chatbots y herramientas de Inteligencia Artificial para la atención de salud mental.

La medida responde a una creciente preocupación por la seguridad de los pacientes, la protección de datos sensibles y la falta de regulación clara en este ámbito.

Por ejemplo, el Departamento de Regulación Financiera y Profesional de Illinois emitió un comunicado el 4 de agosto en el que informa la prohibición oficial del uso de IA para brindar servicios de terapia y psicoterapia, tras la firma por parte del gobernador JB Pritzker de la Ley de Bienestar y Supervisión de Recursos Psicológicos.

“La gente de Illinois merece una atención médica de calidad de parte de profesionales reales y calificados, y no de programas informáticos que extraen información de todos los rincones de internet para generar respuestas que perjudican a los pacientes”, dijo Mario Treto, Jr., secretario de Regulación Financiera de Illinois, en un comunicado de prensa.

Illinois no es el único estado implementando nuevas legislasiones sobre el uso de la IA para servicios de salud mental; Nevada, Utah, Nueva York y Nueva Jersey también han propuesto leyes y normativas específicas para limitar el uso de la Inteligencia Artificial en contextos terapéuticos, según el Washington Post y el New Jersey Monitor.

En Nueva Jersey, la ley busca prohibir a las empresas utilizar IA para actuar como si fueran profesionales de salud mental con licencia.

En algunos casos, como en Illinois y Nevada, la ley propuesta busca impedir por completo que estas herramientas interactúen con pacientes para brindar diagnóstico o tratamiento psicológico, permitiendo únicamente tareas administrativas.

Otros estados, como Utah o Nueva York, no han impuesto una prohibición total, pero sí regulaciones estrictas, como la obligación de informar al usuario que está hablando con una máquina y protocolos para redirigir a servicios de crisis como la línea 988.

Psicósis de IA

Psicósis de IA es un término informal y no clínico que se utiliza para describir situaciones en las que la interacción prolongada o intensa con sistemas de Inteligencia Artificial – sobretodo chatbots – parece contribuir a la aparición de síntomas similares a la psicosis, según Psychology Today.